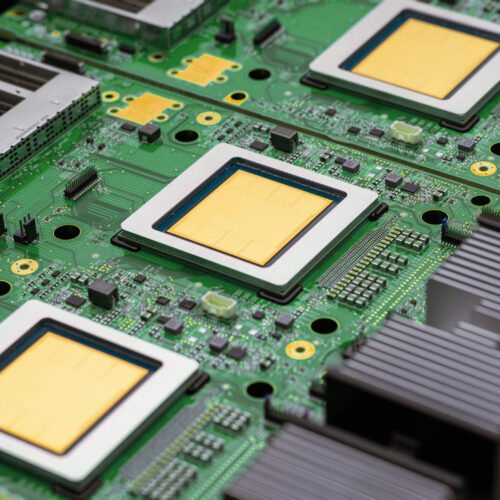

谷歌发布两款专为“智能体时代”设计的新一代TPU芯片

谷歌近日推出了第八代Tensor处理单元(TPU),标志着其AI硬件战略的重大升级。与以往不同,这次发布包含两款芯片:TPU 8t专为AI模型训练设计,而TPU 8i则专注于推理任务。谷歌强调,这一双芯片架构是为了应对“智能体时代”的独特需求,即AI系统正从被动响应转向主动执行复杂任务,从而对硬件效率提出了更高要求。

为什么需要两款芯片?

在AI生命周期中,训练和推理是两个截然不同的阶段。训练阶段涉及大量计算,以优化模型参数,通常耗时数月;而推理阶段则更注重低延迟和高能效,以实时响应用户请求。谷歌指出,使用单一硬件处理这两个环节会导致资源浪费,因此推出专门化的TPU 8t和TPU 8i,旨在提升整体性能。

TPU 8t:加速前沿模型训练

TPU 8t的核心目标是缩短训练时间。谷歌通过更新其服务器集群(称为“pods”),每个pod现在容纳9600个芯片,配备2PB的共享高带宽内存。这种设计支持线性扩展,理论上可连接多达100万个芯片,形成一个逻辑集群。据称,每个pod提供121 FP4 EFlops的计算能力,几乎是前代Ironwood TPU的三倍。此外,谷歌强调TPU 8t的“有效计算率”达到97%,这意味着更少的等待和资源浪费,得益于改进的内存访问处理、自动硬件故障恢复和实时遥测技术。

TPU 8i:优化推理效率

推理芯片TPU 8i则针对部署后的AI应用,如聊天机器人或数据分析工具。它旨在降低延迟和能耗,确保模型在生成响应时保持高效。虽然原文未提供具体性能数据,但谷歌暗示,专为推理设计的架构能更好地平衡计算与内存使用,避免过度配置硬件。

行业背景与影响

谷歌的这一举措反映了AI硬件市场的多元化趋势。尽管英伟达的GPU在AI加速领域占据主导,但谷歌通过自研TPU,在云基础设施中构建了差异化优势。双芯片策略可能推动其他科技公司重新评估其硬件路线图,尤其是在“智能体时代”下,AI任务日益复杂化。然而,这也可能加剧内存等组件的供应链压力,正如文章提及,大规模AI模型的需求正在推高RAM价格。

小结

谷歌的TPU 8t和TPU 8i不仅是技术迭代,更是对AI未来形态的战略押注。通过专精化设计,它们有望加速模型开发周期,降低运营成本,但实际效果还需在商业部署中验证。对于开发者和企业而言,这意味着更快的创新速度和潜在的效率提升,但同时也需关注硬件生态的兼容性与成本变化。